Sztuczna Inteligencja – Artifictial Intelligence (AI) – to wśród tych dostawców wyróżnia się firma IEI Integration Corp. W Polsce wiodącym partnerem IEI Integration Corporation jest firma JM elektronik, a historia wzajemnej współpracy obejmuje już okres ponad 15 lat. Rozwiązania łączące zróżnicowane dziedziny wiedzy: logikę, probablistykę, zbiory rozmyte, metody numeryczne, sieci neuronowe, techniki obróbki cyfrowej obrazów i szereg innych, które w wyniku powstawania coraz to nowych rozwiązań stają się coraz bardziej zalgorytmizowane.

i wiele innych.

Sztuczna Inteligencja kojarzy się co prawda nieco na wyrost z cyfrowym bytem obdarzonym samoświadomością, w praktyce aplikacje AI maja wybitnie użytkowy charakter a liczba komercyjnych rozwiązań rośnie z postępem wykładniczym.

Sztuczna inteligencja staje się coraz popularniejsza ponieważ dostępne są ustandaryzowane narzędzia wspierające twórców aplikacji.

Naszym zdaniem bez wkładu firmy Intel nie byłoby dziś tak dynamicznego rozwoju AI.

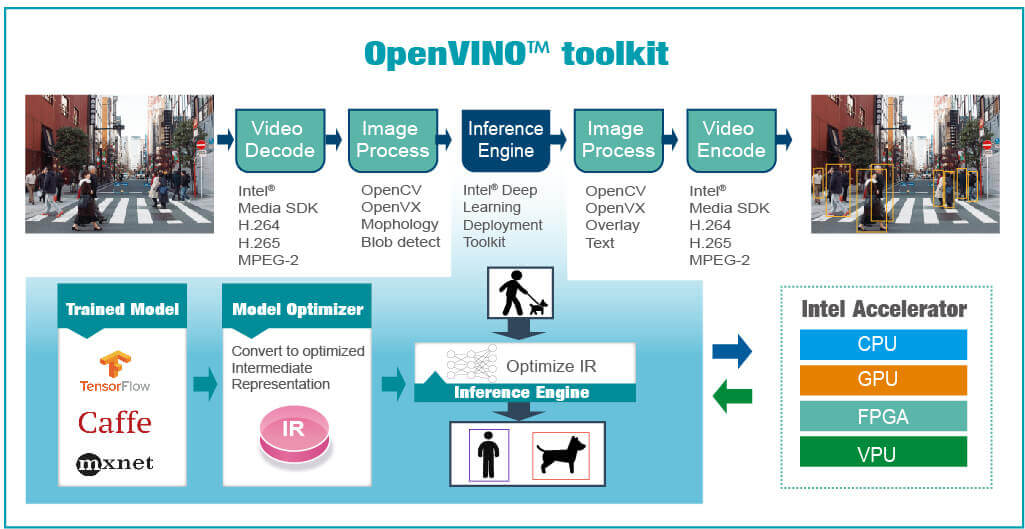

Firma Intel opracowała środowisko OpenVINO wraz z udostępnieniem transferu wiedzy w ogólnodostępnych kanałach Social Media. Intel opracował także szereg dedykowanych mikroprocesorów dla akceleratorów sprzętowych stosowanych w komputerach dla przyspieszenia działania AI.

Intel wspiera rozwój ekosystemu zbudowanego wokół OpenVINO, w skutek czego istnieje szereg rozwiązań współpracujących w dziedzinie uczenia maszynowego, sieci neuronowej i budowy modeli, rozpoznawania obrazu, a z pośród najpopularniejszych wymienić należy takie rozwiązania jak GitHub, Model Zoo, Caffe, mxnet, TensorFlow i wiele innych.

Wiodący na świecie dostawcy komputerów współpracują z firmą Intel w opracowaniu sprzętu komputerowego wspierającego Sztuczną Inteligencję

Firma IEI specjalizuje się w projektowaniu i produkcji sprzętu komputerowego dedykowanego zastosowaniom przemysłowym. W praktyce oznacza to tyle, że komputery dostarczane przez IEI są dostosowane do pracy w trudnych warunkach, jak wibracje, wstrząsy, wysoka lub niska temperatura i do pracy ciągłej 7dni/24h. Często rozwiązania bezwentylatorowe, z wysokim stopniem szczelności IP, z preferencją wykorzystania dysków SSD o podwyższonej żywotności itp.

Popularność komputerów produkcji IEI wynika także z dobrego stosunku jakości do ceny. Aspiracją IEI od początku swojej działalności jest dostarczanie Klientom sprzętu wysokiej jakości w cenie nie stanowiącej bariery wejścia w nowe technologie.

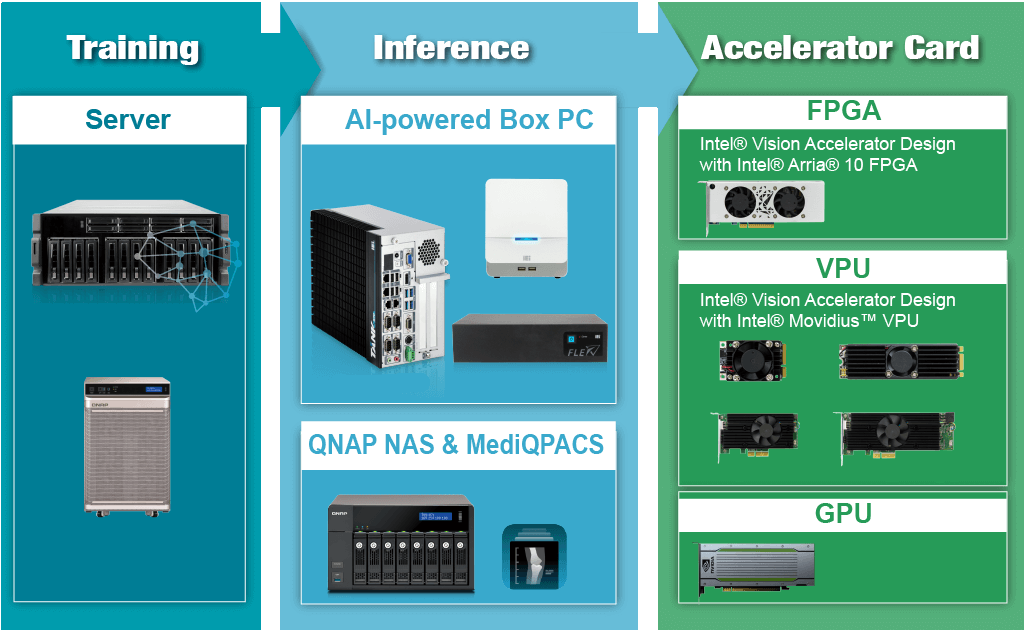

Sztuczna Inteligencja zależnie od fazy projektu i rodzaju aplikacji wymaga innego wsparcia sprzętowego.

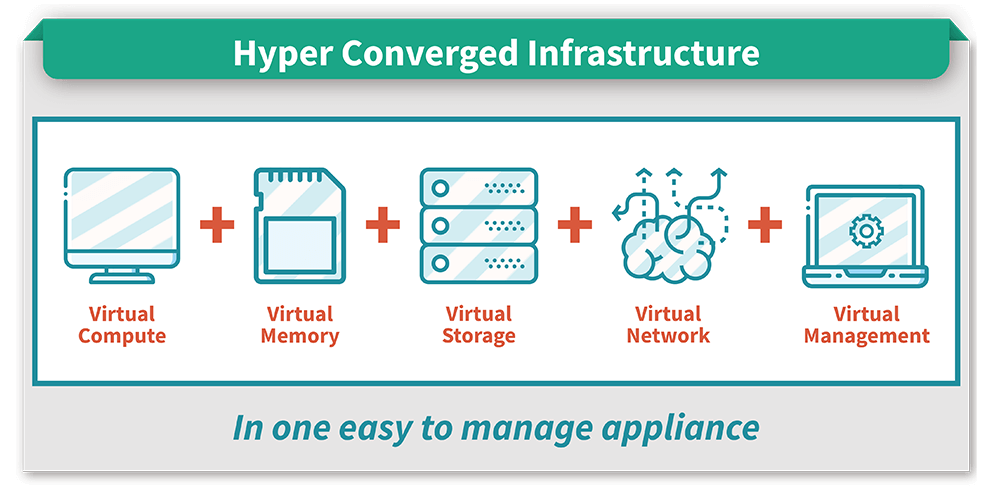

Na początku Sztuczna Inteligencja wymaga dużych zasobów na których opracowywany jest właściwy wyjściowy model. Wydajne serwery treningowe o hiperkonwergentnej architekturze (HCI) skalowalna w poziomie i wyposażone w akceleratory wspierają opracowanie wynikowego modelu AI.

Wykonawcza warstwa aplikacji AI – Inference – to miejsce gdzie wpływające dane są interpretowane przez wytrenowany model, sieć neuronową – i w tej warstwie sprzętowej potrzeby Sztucznej Inteligencji są niższe, jak w serwerze treningowym.

Popularnym pojęciem spotykanym w projektach AI jest akcelerator, czyli przyspieszacz sprzętowy, zwiększający wielokrotnie wydajność podstawową komputera, na którym pracuje Sztuczna Inteligencja. Akceleratory wykorzystywane są zarówno w serwerze treningowym jak i w komputerach warstwy Inference.

W sprzęcie dla sztucznej inteligencji opartej na OpenVINO spotykamy akceleratory oparte na procesorach Movidius Myriad i Arria opracowanych przez firmę Intel.

Przetwarzanie danych wymaga wydajnego procesora, a w serwerze GRAND-C422 zastosowano procesory Intel Xeon 14nm w maksymalnej 18 rdzeniowej wersji z systemem chłodzenia wykorzystującym ciecz. Chłodzenie cieczą pozwoliło na zamknięcie mocy obliczeniowej w relatywnie niewielkich rozmiarów obudowie.

Na zgromadzonych w serwerze treningowym danych wykonywany jest proces budowy właściwej AI.

GRAND-C422 pełni rolę pełnowymiarowego serwera treningowego dla sztucznej inteligencji, umożliwiającego efektywna budowę mechanizmu wnioskującego w oparciu o zgromadzoną w zasobach dyskowych i/lub w chmurze bazę. GRAND-C422 zapewnia inżynierom wyspecjalizowanym w Sztucznej Inteligencji możliwość zainstalowania aż 4 akceleratorów. W maksymalnej konfiguracji może to być nawet 32 dodatkowych procesorów Movidius Myriad. Taka moc wymaga adekwatnego zasilania, które w przypadku serwera GRAND-C422 zamyka się w redundantym zasilaczu o mocy 1,6 kW.

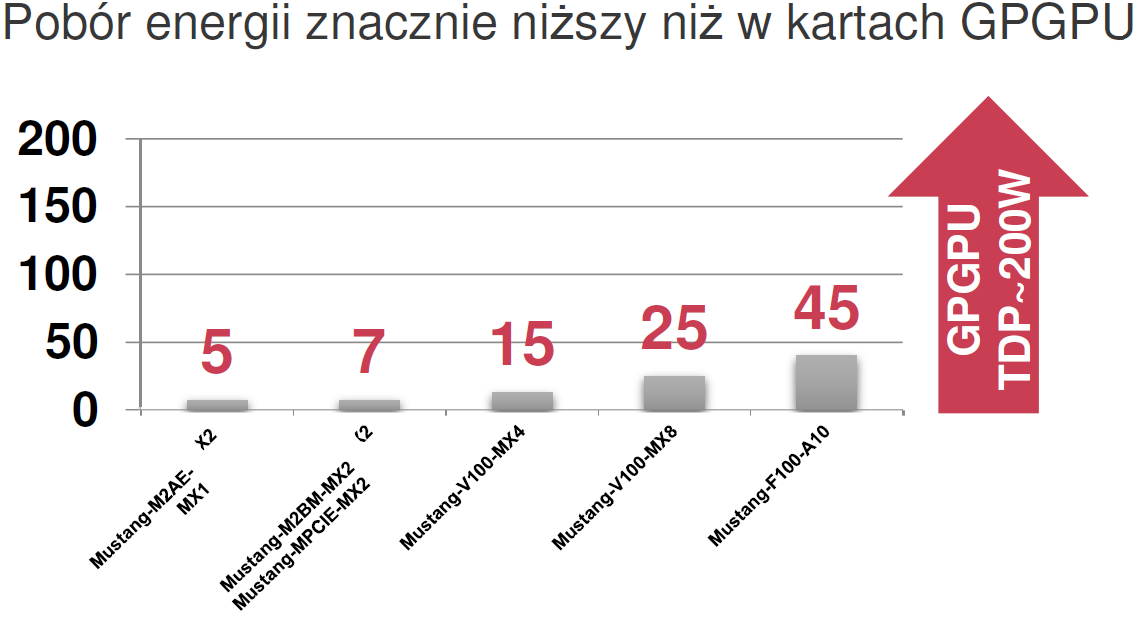

IEI jest producentem całej rodziny akceleratorów MUSTANG opartych na mikroprocesorach Movidius Myriad i Arria produkcji Intel.

W warstwie wykonawczej Sztucznej Inteligencji – Inference - wykonywany jest kod wynikowy, powstały na serwerze treningowym. Nasza firma wraz z IEI stawia do dyspozycji projektantów AI cały szereg komputerów spełniających zróżnicowane wymogi wynikowej warstwy Sztucznej Inteligencji, począwszy od mocnych jednostek, które w miarę potrzeby są nawet w stanie pełnić rolę serwerów treningowych, skończywszy na energooszczędnych, niewielkich gabarytowo, bardzo wytrzymałych mechanicznie komputerach do pracy na kodzie wynikowym w skrajnie trudnych warunkach.

Komunikacja z kartami rozszerzeń odbywa się z wykorzystaniem pełnowymiarowego złącza PICMG w najnowszym, najszybszym standardzie PCIe Express Gen. 3.0 Komputer RACK-500 AI sprawdzi się doskonale jako wysokowydajny komputer warstwy wykonawczej z interfejsem graficznym wysokiej rozdzielczości – aż dwa wyjścia jakości 4K.

Stosunek jakości do ceny wydaje się szczególnie atrakcyjny w przypadku komputera RACK-500, tym bardziej, jeśli ma pełnić rolę zarówno serwera treningowego sztucznej inteligencji jak i Inference dla AI.

Warto podkreślić, iż cechuje go duża elastyczność rozbudowy sprzętu.

Komputer jest posaida dwa wejścia zasilające, z których jedno odpowiada za zasilanie płyty głownej a drugie modułów rozszerzeń. Wejście zasilające zapewania dodatkowe zasielnie dla modułów które wymagają więcej niż 75W.

TANK-XM810 zaprojketowany z myślą o niezawodności jest chłodzony pasywnie przez radiator wykorzystujący koncepcję pin-fin, która poprawia dwuwymiarowe przewodzenie ciepła oraz zapewnia znacznie lepsze odbieranie ciepła z wnętrzna obudowy.

Seria komputerów TANK-XM810 zapewnia łączność przewodową jak i bezprzewodową. Komputer obsługuje najwyższy standrat Wi-Fi 6 oraz Bluetooth 5.0 a jedne ze slotów na złączu M.2 zapewnia obslugę sieci 5G. W standardzie komputer posiada 2 porty Ethernet 2.5GbE jaednak można go wyposażyć w dodatkowe 6 portów Ethernet PoE+. Każdy z portów PoE jest w stanie zapewnić zasialnie o mocy 30W.

Przemysłowe przeznaczenie komputera TANK-XM810 podkreśla dostępność portów szeregowych standardowo wykorzystywanych w automatyce 2xRS232/422/485 i kolejne 4xRS232.

Dodatkowo 12 pinowe złącze na cyfrowe I/O.

Komunikację ze standardowymi peryferiami zapewnia dostępność aż 8 portów USB (6x3.2 i 2x USB 2.0).

Niezapomniano także o komfortowej pracy operatora, komputer posiada dwa wyjścia graficzne 4K (HDMI 1.4 4094x2160/30Hz, DP++ 4096x2304/60Hz) zintegrowane z audio.

Rodzina TANK jest popularnym rozwiązaniem w ofercie firmy IEI . Marka komputera TANK jest także dobrze znana w Polsce, gdzie komputery z tej rodziny znalazły wielu nabywców.

Ten konkretny komputer dla AI bazuje na wydajnym procesorze Xeon E3-1268LV5, i5 lub i7, z przestrzenią pamięci do 32GB RAM DDR4 (a więc mniej jak w RACK-500).

Komputer został wyposażony w dużą liczbę portów I/O przeznaczonych do komunikacji z otaczającymi go urządzeniami automatyki przemysłowej. Posiada m.in. 4 porty USB 3.0, 4 porty USB 2.0, 2 x RJ-45, 2x RS-232/422/485 (DB9), 4x RS-232 (2x Rj-45, 2x DB-9 z ochroną izolacji do 2,5 KV), VGA, HDMI, wyjście liniowe i mikrofonowe oraz 2 porty LAN (Ethernet przemysłowy) a także we/wy cyfrowe 8 i 4-bitowe.

Dwa sloty na magistrali PCIe przeznaczone są do podłączenia akceleratorów Mustang.

Zwarta i trwała konstrukcja umożliwia pracę przy wstrząsach i wibracjach, zgodnie z MIL-STD, a zakres temperaturowy pracy zaczyna się już od -20 st C.

W stosunku do komputera RACK-500 AI TANK jest konstrukcją o wiele bardziej zwartą. W miejsce obudowy dostosowanej do szafy Rack19” zastosowano stalowo-aluminiową konstrukcję o zewnętrznych wymiarach 121.5 x 255.2 x 205 mm co predysponuje ten komputer do zastosowania w aplikacjach działających w ograniczonej przestrzeni.

Komputer FLEX-BX200 dedykowany sztucznej inteligencji posiada modułową i zwartą obudowę 357 x 230 x 88 mm (2U) umożliwiającą integrację z wyświetlaczem przemysłowym produkcji IEI, uzyskując w ten sposób zwartą konstrukcję komputera All-In-One.

FLEX-BX200 posiada 6 portów USB 3.2 i dwa porty LAN GbE (RJ45) Komputer dla AI jakim jest FLEX-BX200 wyposażono wyłącznie w jedno wyjście HDMI.

Trudno tutaj mówić o tak wytrzymałej konstrukcji jak TANK czy RACK, nie mniej komputer zapewnia większą od przeciętnej wytrzymałość na wstrząsy i wibracje, a temperatura operacyjna zaczyna się już od -20 st.C Przemysłowy rodowód komputera można rozpoznać także po dostępności dwóch portów RS232 (DB-9).

Całość wyróżnia bardzo dobry stosunek jakości do ceny, gdyż FLEX-BX200 w sprzyjającej konfiguracji można nabyć za cenę niemal dwukrotnie niższą, jak podobnie skonfigurowany komputer TANK.

Komputer da AI DRPC-230 to w pełni komputer przemysłowy, odporny na wstrząsy i wibracje zgodnie z MIL-STD i zakresem temperaturowym pracy od -20 stC.

Unikalną cechą tego komputera jest – oprócz wielu portów - 7 portów USB (w tym 6 USB 3.2) , 3 porty do Ethernetu przemysłowego, 4x RS-232/422/485 (DB9), 2x RS-232 (RJ/45),– możliwość zamontowania karty Ethernet PoE z 4 wyjściami RJ45. Komputer został wyposażony w jedno wyjście HDMI.

Komputer DRPC może więc zasilać 4 urządzenia IP poprzez kabel Ethernet i można sobie wyobrazić aplikację do wizualnej kontroli jakości czy automatycznej identyfikacji osób wykorzystującej sztuczną inteligencję, z zastosowaniem 4 kamer IP wysokiej rozdzielczości, zasilanej z wykorzystaniem PoE.

Cena zakupu komputera DRPC-230 jest wyższa, jak w przypadku podobnie skonfigurowanego komputera FLEX, lecz niższa w porównaniu adekwatnie wyposażonym komputerem TANK.

W warstwie wykonawczej Inferencje sztucznej inteligencji komputer ITG-100 AI doskonale sprawdzi się we wszelkiego rodzaju aplikacjach mobilnych, umieszczanych w pojazdach, wózkach widłowych i wszędzie tam, gdzie zasilanie jest istotnie ograniczone, a przestrzeń do zabudowy wręcz mikroskopijna. Maksymalna moc pobierana przez ten komputer to zaledwie niecałe 15W.

Komputer posiada 2 wyjścia USB 3.0, 2x GbE LAN, 2x RS-232/422/485, 1x VGA.

W ofercie firmy JM elektronik znajduje się pozycji przydatnych w opracowaniu i eksploatacji rozwiązań Sztucznej Inteligencji. Spośród propozycji JM elektronik znajda Państwo urządzenia komunikacyjne - jak karty Ethernet ze złączami RJ45 i możliwością zasilania PoE.

Firma iEi zapewnia narzędzia programistyczne do GPOE do zarządzania i sterowania każdym portem PoE. Narzędzia mogą kontrolować moc, monitorować prędkość i przetwarzać transfery danych przez sieć Ethernet LAN. Karta działa pod kontrolą systemu Windows i Linux.

Nie można w rozważaniach o platformie sprzętowej dla AI pominąć środowisko Jetson promowane przez NVIDIA i komputery ARM, bazujące na systemie operacyjnym Android/Linux.

NVIDIA buduje ekosystem firm wokół sztucznej inteligencji Jetson i skłania swoich Partnerów do dzielenia się wiedzą na Portalu NVIDIA Developer.

Na portalu tym oraz w kanałach Social Media, w szczególności na niezwykle popularnym kanale Youtube można znaleźć wielogodzinne prelekcje, prezentacje, case-studies, poradniki i video-kursy.

Środowisko programistyczne Jetson SDK jest wspierane przez takich dostawców frameworków do uczenia maszynowego jak: TensorFlow, PyTorch, Caffe2, Keras, MXNet, Theano.

NVIDIA oparła swoją ofertę Jetson na szeregu akceleratorów, certyfikując ich producentów oraz platformy, w ramach kanału partnerskiego.

Prezentowana platforma znajdzie zastosowanie m.in. w dronach, obrazowaniu medycznym, modelowaniu 3D, automatycznej kontroli optycznej i bramach AI.

Dzięki temu bardzo dobrze sprawdza się w przetwarzaniu danych w czasie rzeczywistym, szczególnie w rozwiązaniach, w których opóźnienia w przetwarzaniu danych mogą stanowić problem, jak roboty, samojezdne wózki magazynowe, komercyjne drony czy inteligentne kamery dla Smart City.

AN310-TX2 może pracować w temperaturach od -25 ° C do 80 ° C. Jego niewielkie rozmiary pomagają opracować aplikację do obserwacji 360 ° w pojazdach, dronach, robotach, monitoringu i automatyzacji.

AN510-TX2 idealnie nadaje się do wykorzystania w aplikacjach pracujących w wymagających środowiskach i o ograniczonej przestrzeni, np. w przenośnych urządzeniach medycznych czy robotach.

AN622-TX2 został zaprojektowany w obudowie Nano-ITX (120mm x 120mm). Zapewnia wysokiej jakości przesyłanie danych nawet w temperaturze od -20 ° C do 70 ° C. Dzięki temu AN622-TX2 może pracować w aplikacjach działających w wymagających środowiskach.

Jetson Xavier NX posiada wiele trybów poboru mocy. Jednym z nich jest tryb niskiego poboru mocy dedykowany dla systemów zasilanych bateryjnie, zapewniając zarówno moc obliczeniową aplikacjom AI (10W przy 14 TOPS) jak i czujnikom i urządzeniom peryferyjnym.

AX710-X32 oparty na akceleratorze Jetson AGX pomaga w opracowywaniu aplikacji VID (Video-Image-Detection) o wysokiej rozdzielczości, w robotyce, AOI, logistyce magazynowej, inspekcji, służbie zdrowia czy handlu detalicznym.

Jeśli chcesz razem z nami zgłębiać tajniki AI skontaktuj się pod adresem iit[at]jm.pl Chętnie odpowiemy na zapytania techniczne i cenowe.